VR-Anwendungen leben von Immersion – dem Gefühl, vollkommen in fremden Welten abzutauchen. Ein wichtiger Faktor ist die Glaubwürdigkeit der dargestellten Umgebung. Fotorealistische 3D-Modelle von komplexen Objekten zu erstellen ist jedoch mit hohem Aufwand verbunden – manuelles 3D-Modelling kann schließlich viel Zeit verschlingen und hohe Kosten verursachen.

Mit photogrammetrischen Verfahren wird dieser Arbeitsschritt enorm vereinfacht. Reale Objekte und Umgebungen werden sozusagen samt ihrer Tiefeninformationen „eingescannt“ und werden direkt in die digitale Welt übertragen, wo sie dann weiterverarbeitet werden können. Natürlich ist dieser Prozess aufwändiger als der Scan eines zweidimensionalen Dokuments, doch mit etwas Erfahrung und Sorgfalt können in kurzer Zeit beeindruckende Ergebnisse erzielt werden.

Für das Berliner Crypto-Startup BLNFT konnten wir unsere Erfahrungen im Bereich der Photogrammetrie jüngst unter Beweis stellen und freuen uns, Ihnen heute einen kleinen Einblick in dieses Projekt und unseren Workflow geben zu können.

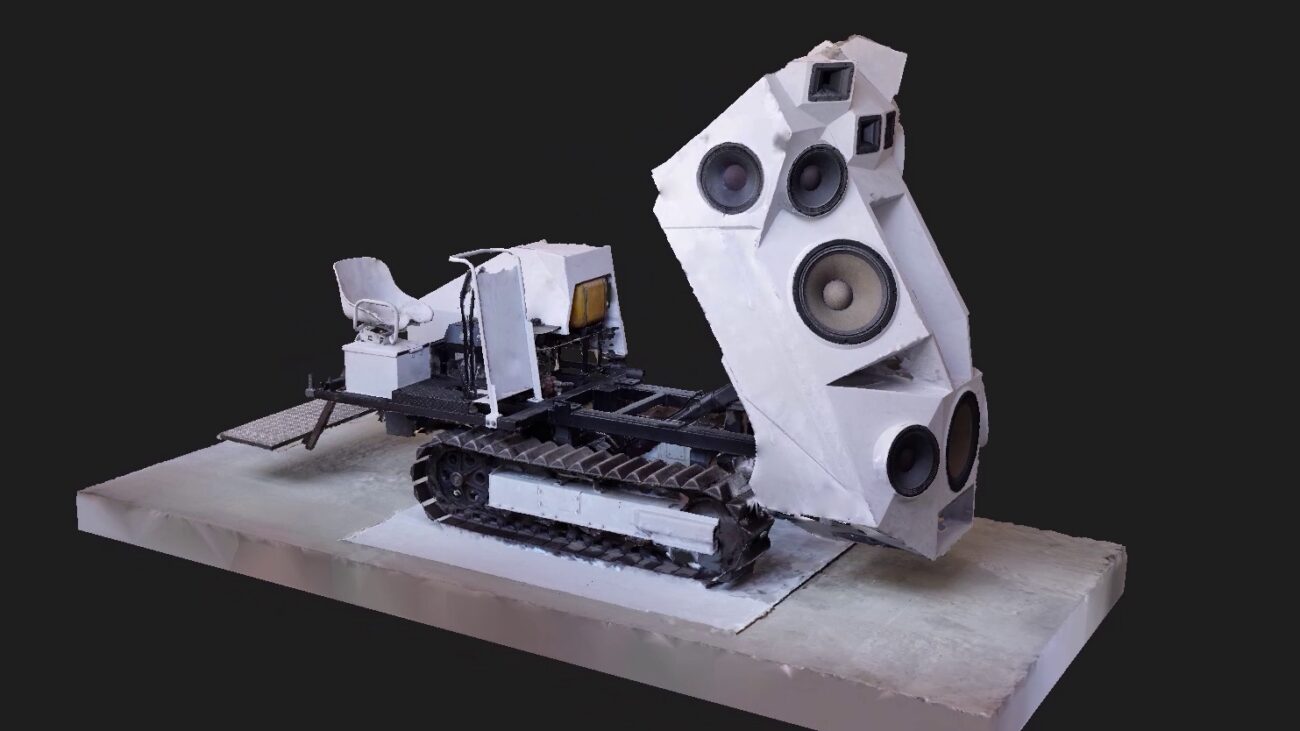

Überblick über verschiedene Stufen bis hin zum fertigen 3D-Modell – dieses Modell wurde ausschließlich in einer Photogrammetrie-Software erstellt und noch nicht in 3D-Software nachbearbeitet – „Löcher“ und Unebenheiten können in einem weiteren Arbeitsschritt entfernt werden.

Ein Panzer wird zum NFT

Non-Fundable-Tokens (NFTs) sind in aller Munde. Verkäufe der „digitalen Echtheitszertifikate“ auf Basis der Blockchain-Technologie sind fälschungssicher, dezentral gespeichert und öffentlich einsehbar. Auf diese Weise können auch aus Werken, die rein digitaler Natur sind, Unikate geschaffen werden – das ermöglicht beispielsweise Künstlern, für das Kreieren digitaler Kunstwerke gerecht entlohnt zu werden.

BLNFT brennt genau für diese Berührungspunkte der Kunstwelt mit der neu entstandenen Crypto-Szene und hat in den letzten Jahren allerhand spannender Projekte in der Blockchain umgesetzt. Dabei arbeitet das Team von BLNFT eng mit Künstlern aus der Berliner Szene zusammen, so auch mit Nik Nowak.

Nik Nowak kreiert Multi-Media-Arbeiten, die von Installationen über Performances, Skulpturen, Videos bis hin zu Gemälden reichen. Seine Installation „Panzer“ aus dem Jahr 2011 ist ein funktionstüchtiges Kettenfahrzeug, das jedoch an Stelle von Waffen Lautsprecher und Soundsysteme geladen hat. Im Rahmen der „NFTBERLIN Unconference“, einer NFT-Konferenz im Herzen von Berlin, wurde der Panzer photogrammetrisch gescannt.

Hier kommen wir von Aspekteins ins Spiel: Unsere Aufgabe in diesem Projekt bestand darin, das Kunstwerk realitätsgetreu in die virtuelle Welt zu bringen. Die Besucher konnten unserem Mitarbeiter auf der Konferenz direkt über die Schulter schauen und live mitverfolgen, wie ein reales Kunstwerk zum digitalen Artefakt wird. Das 3D-Objekt, das so entstanden ist, bildet die Basis für künftige interaktive Anwendungen, die den Panzer in Zukunft in der Virtual und Augmented Reality erlebbar machen.

Das digitale Objekt wird von BLNFT fraktioniert und als Community Token, sozusagen Eintrittskarten in eine Online-Community, bereitgestellt.

Ausgangsbasis für ein gutes Photogrammetrie-Modell sind Fotos, die mit der richtigen Technik erstellt wurden.

Was ist Photogrammetrie und wie funktioniert das

Doch was ist eigentlich Photogrammetrie? Kurz gefasst handelt es sich dabei um eine Technik, mit der reale Objekte – oder auch ganze Räume und Landschaften – als 3D-Modelle digitalisiert werden können. Die so entstandenen Modelle sind besonders realitätsgetreu und wirken fotorealistisch.

Als Basis für Photogrammetrie dienen zahlreiche Fotos, die aus verschiedenen Perspektiven rund um das zu digitalisierende Objekt angefertigt werden. Eine Software analysiert deren Bildinhalte und erkennt automatisch Bildpunkte, die in mehreren Fotos zu sehen sind.

Eine Software ermittelt die Ausrichtung und Positionierung der Kamera für jedes Foto und erstellt eine Punktwolke.

Relevant sind dabei zuvorderst die Parallaxen-Verschiebungen: Wenn in mehreren Fotos aus verschiedenen Perspektiven die gleichen Bildinhalte zu sehen sind, kann die Software erkennen, wie sich Bildpunkte im Vordergrund im Gegensatz zu Bildpunkten im Hintergrund verschoben haben. Mithilfe dieser Unterschiede kann die Positionierung der Fotos in Relation zueinander bestimmt werden. Die Software weiß damit, wo sich die Kamera bei jedem Foto befunden hat.

Dies dient als Basis zur Berechnung einer Punktwolke: Mit der Information, wo die Kamera im Raum platziert war und welche Bildpunkte in welchen Kameras zu sehen sind, kann die Position der Bildpunkte im 3D-Raum ermittelt werden. Durch die Anordnung einer Vielzahl von Bildpunkten entsteht ein schemenhaftes Abbild des dreidimensionalen abgelichteten Objekts. Um ein undurchlässiges 3D-Modell zu erhalten, kann eine Oberfläche über die Punktwolke gestülpt werden.

Aus der Punktwolke kann ein untexturiertes 3D-Modell generiert werden.

Nach diesem Schritt haben wir nun also ein farbloses Abbild des 3D-Objekts. Auch für die Farbe kann auf die Original-Fotos zurückgegriffen werden. Aus den Fotos wird eine Textur generiert, die auf die Oberfläche unseres neuen 3D-Modells projiziert wird. Wir haben nun ein täuschend echtes Abbild unseres Objekts, das wir von allen Seiten betrachten und auch in digitalen Welten wie VR- und AR-Anwendungen verwenden können.

Das Fotografieren und die Fallstricke bei einem Live-Event

Damit Photogrammetrie so reibungslos funktionieren kann wie oben beschrieben, sollte natürlich auf einige Dinge geachtet werden – und gerade der Umstand, dass der Soundpanzer im Rahmen eines Live-Events „gescannt“ wurde (so wird der Prozess genannt, bei dem Fotos von allen Seiten geschossen werden) bringt nochmals weitere Herausforderungen mit sich.

- Jeder Punkt auf dem Objekt muss aus mindestens 2, besser 3 Fotos zu sehen sein

- Zwischen zwei Bildern muss die Kamera immer verschoben werden (und nicht nur gedreht), damit ein Parallaxen-Effekt entstehen kann

- Bildrauschen muss so weit es geht vermieden werden, da dieses falsche Ergebnisse erzeugen kann. Neben der Auswahl der Kamera kann dies vor Allem erzielt werden, indem der ISO möglichst niedrig bzw. möglichst auf den Native-ISO-Wert der Kamera eingestellt wird. Hierzu muss u. U. die Lichtsituation, die Blende oder die Belichtungszeit angepasst werden.

- Das gesamte Objekt muss von vorne bis hinten komplett scharf sein. Dies erfordert meist eine möglichst geschlossene Blende, um den Schärfebereich der Kamera zu vergrößern. Auch ein Weitwinkel-Objektiv ist hilfreich.

- Um Wackler zu vermeiden empfiehlt es sich, wo möglich ein Stativ einzusetzen. Bei Fotografien aus der Hand muss ein Kompromiss aus Belichtungszeit, Blende und ISO gefunden werden, der Wackler vermeidet und das Bild dennoch möglichst rauschfrei und scharf erscheinen lässt.

- Das Objektiv sollte so gewählt werden, dass möglichst wenig Verzerrungen erzeugt werden. Es ist dringend dazu zu raten, eine Festbrennweite anstatt eines Zoom-Objektivs zu nutzen.

Und so sieht das Modell aus, nachdem es mit einer Textur überzogen wurde, die ebenfalls aus den Fotos generiert werden kann.

Der optimale Workflow für Photogrammetrie-Aufnahmen

- Es empfiehlt sich, zunächst Bilder des Objekts in einer totalen Einstellung kreisrund um das abzulichtende Objekt herum anzufertigen. Hierzu wird die Kamera zwischen jedem Foto ein Stück weiter entlang des Kreises gesetzt, so dass die Bestandteile, die auf dem vorherigen Bild sichtbar waren, zu mindestens 2/3 immer noch sichtbar sind.

- Dieser Vorgang wird auf verschiedenen Ebenen wiederholt (indem das Stativ nach jedem Durchgang auf eine andere Höhe eingestellt wird).

- Nun geht es näher an das Objekt heran: Zusätzliche Fotos aus verschiedenen Winkeln bilden Details genauer ab. Dabei sollte stets von weiten Aufnahmen langsam (mit mehreren Zwischenschritten) in nähere Fotos übergegangen werden, sodass die Software die Close-Ups später gut zuordnen kann. Für die Erstellung der Textur in einer gleichbleibenden Qualität ist es hilfreich, das gesamte Objekt in einem ähnlichen Minimalabstand abzulichten.

- Gerade Bestandteilen des Objekts, die nur in bestimmten Winkeln sichtbar sind (beispielsweise der Motor des Soundpanzers), sollte ein gehobenes Maß an Aufmerksamkeit gewidmet werden. Da sich hier teilweise Fotos aus der Hand nicht vermeiden lassen, muss unbedingt geprüft werden, ob die Fotos scharf und nicht verwackelt sind – fehlerhafte Fotos können den Algorithmus in der Postproduktion später gehörig durcheinander bringen.

- Im Zweifel sind zu viele Fotos besser als zu wenige – aussortieren kann man sie später immer noch.

Auch komplexe Strukturen können durch Photogrammetrie detailgenau abgebildet werden, wie diese Punktwolke der Ketten des „Panzers“ zeigt.

Die Postproduktion

Die Postproduktion beginnt am Besten direkt vor Ort – so können sofort Bilder nachgeschossen werden, wenn sich abzeichnet, dass es ungeahnte Lücken an Bildinformationen gibt oder wenn die Software Probleme hat, Bilder zuzuordnen, da die Unterschiede zu benachbarten Fotos zu groß sind. Zuerst sollten alle Bilder nochmals an einen großen Bildschirm gesichtet werden, um auszuschließen, dass es ein unscharfes oder verwackeltes Bild in die Auswahl geschafft hat. Mit einer Bildbearbeitungssoftware können bei Bedarf Schatten abgemildert werden – bestenfalls sollten diese jedoch schon bei der Aufnahme minimiert werden. Wenn dann alles vorbereitet ist, startet die eigentliche Magie der Photogrammetrie.

Wir bei Aspekteins verwenden das Programm RealityCapture von Capturing Reality (eine zugegeben mehr als verwirrende Namensgebung). Capture Reality wurde 2021 von Epic Games, die mit ihrer Unreal Engine einen der Marktführer im Segment der Games-Engines stellen, gekauft – das wundert kaum, wenn man bedenkt, dass RealityCapture das wohl derzeit beste Tool für Photogrammetrie ist.

RealityCapture bietet Tools für sämtliche nötige Arbeitsschritte von der ersten Analyse der Fotos, über die Bestimmung der Kamerastandorte und Berechnung einer Punktwolke, der Erstellung eines 3D-Modells und der Erstellung einer hochauflösenden Textur. Jeder Schritt ist dabei durch zahlreiche Variablen fein justierbar, so dass ein optimales Ergebnis gewährleistet werden kann.

Photogrammetrie kann viel, doch in den seltensten Fällen ist das Ergebnis selbst bei sorgfältiger Anpassung aller Parameter perfekt. Bildrauschen kann so beispielsweise zu ungewünschten Unebenheiten in den Oberflächen führen. Einfarbige Flächen mit wenigen Details können unter Umständen nicht richtig erkannt werden, was zu Abbildungslöchern führt. Spiegelnde und stark reflektierende Flächen sorgen fast zwangsweise für Fehler.

Löcher im Modell, wie hier zu sehen, können in der Nachbearbeitung „gestopft“ werden.

Um dies zu beheben, wird das 3D-Modell in eine 3D-Modellingsoftware importiert und dort aufbereitet. Wir verwenden für das Soundpanzer-Modell Houdini von SideFX, doch auch Tools wie Maxon Cinema4D, Autodesk 3ds Max oder Blender wären für diesen Arbeitsschritt eine ebenso gute Wahl.

Nach all diesen Schritten ist es fertig – das fotorealistische Abbild des Panzers von Nik Nowak.

Wir haben Ihr Interesse für Photogrammetrie geweckt? Gerne stehen wir Ihnen nicht nur bei Konzeption und Produktion von VR- und 360°-Anwendungen, sondern selbstverständlich auch bei der Erstellung aller dafür nötigen Inhalte wie photogrammetrisch erstellter 3D-Objekte mit unseren Experten zur Seite.