Als eine auf immersive Medien spezialisierte Agentur helfen wir regelmäßig Kunden aus den verschiedensten Bereichen dabei, VR in ihr Unternehmen zu integrieren. In unserer Artikelreihe „VR-Konzepte mit ungenutztem Potential – Virtuelle Realität der Zukunft“ stellen wir in der Regel Konzepte vor, die es noch nicht in die Umsetzung geschafft haben. Heute sprechen wir aber über kein konkretes Konzept: Vielmehr wollen wir Ihnen einen Überblick über die ersten Entscheidungen geben, die es auf dem Weg zur Konzeption einer VR-Erfahrung zu treffen gilt.

Im Rahmen eines Workshops erläutern wir Ihnen basierend auf Ihren Anforderungen die möglichen Umsetzungsvarianten technischer und inhaltlicher Art. Für diesen initialen Wissenstransfer und die einhergehende Beratungsleistung veranschlagen wir in der Regel 2000 Euro, die hälftig bei Beauftragung der Umsetzung verrechnet werden.

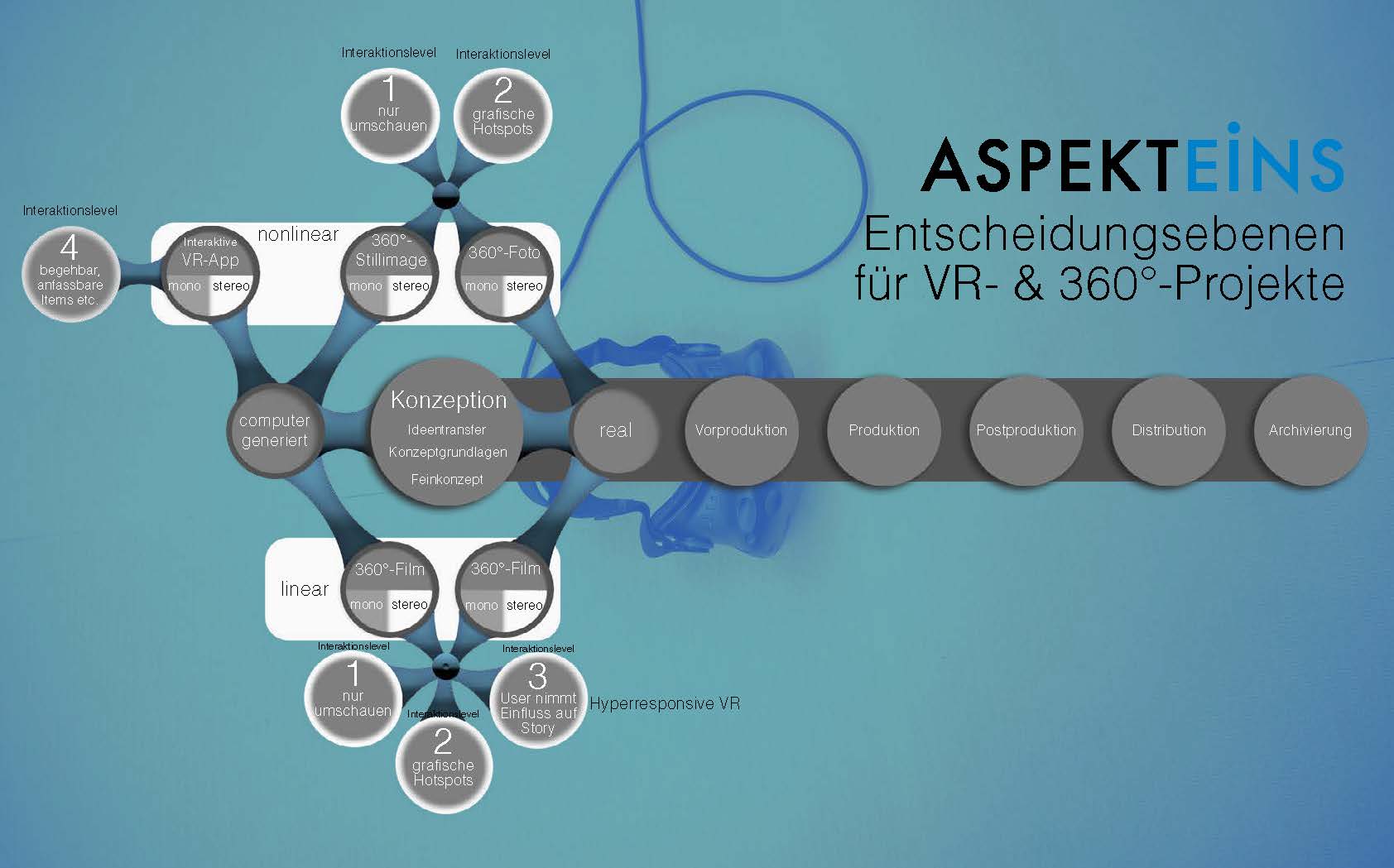

Der Weg zu Ihrem konkreten Projektkonzept führt dabei über drei Stufen: einen initialen Ideenaustausch, die Festlegung der Konzeptgrundlagen sowie die finale Erstellung Ihres individuellen Konzepts.

© Foto: Startup Stock Photos (Pexels)

Anforderungen ermitteln

In den meisten Fällen ist es sinnvoll, Projekte zunächst mit einer größtmöglichen Offenheit für Ideen anzugehen. Wir beginnen daher damit, die groben Rahmendaten eines Projekts festzustecken: Welche Kommunikationsziele sollen erreicht werden? Welches Budget steht dabei zur Verfügung? In welchem Zeitrahmen soll die Produktion stattfinden? Gibt es spezielle Eigenschaften, die das Projekt erfüllen muss? Beim ersten unverbindlichen Zusammenkommen können Sie uns Ihre Wünsche mitteilen und Ihre Vorstellungen erläutern. Angefangen bei Ihrer groben Ideenskizze bis hin zum konkret ausformulierten Projektplan: Sie haben etwas ganz Neues vor oder Ihr VR-Projekt soll sich an einer bereits bestehenden VR-Erfahrung inhaltlich und/oder im Design orientieren? Während der weiterführenden Kommunikation werden konkrete Eckpfeiler Ihrer VR-Erfahrung basierend auf den technischen und finanziellen Möglichkeiten definiert.

Die wichtigsten Entscheidungen und Prozesse auf dem Weg zur eigenen VR-Experience. Zum Vergrößern klicken.

Projektformat

Sobald diese grundsätzlichen Parameter geklärt sind, gilt es zu entscheiden, welches Projektformat verwendet werden sollte. Wir unterscheiden hier grundsätzlich zwischen 360-Grad-Projekten, die entweder auf Echtfilmmaterial oder vorgerenderten Computergrafiken basieren und in Echtzeit berechneten VR-Applikationen. 360-Grad-Projekte haben eine geringere Einstiegshürde. Sie können vergleichsweise kostengünstig produziert werden und sind kompatibel mit einer Vielzahl von Social-Media-Kanälen und 360-Grad-Playern. Das Interaktionspotential ist allerdings sehr gering und die Bewegungsfreiheit ist stets auf drei Achsen eingeschränkt – man kann sich also umsehen, aber nicht bewegen. In Echtzeit berechnete VR-Applikationen erlauben dagegen – das passende VR-Headset vorausgesetzt – Bewegungen auf sechs Achsen und umfangreiche Interaktionsmöglichkeiten.

© Foto: Samuel Zeller (Unsplash)

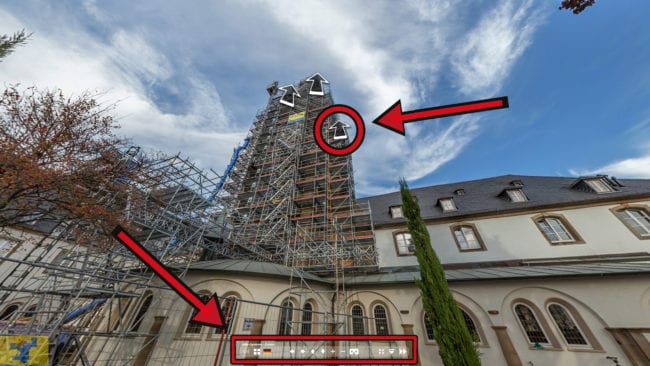

Bei der Wahl der Drehorte für 360-Grad-Filme, die auf Echtfilmmaterial basieren, sollten mögliche Parallaxen-Fehler bedacht werden. So können zusätzliche Aufwände in der Postproduktion vermieden werden. 360°-Kameras besitzen mehrere Linsen, die in verschiedene Richtungen weisen und gemeinsam ausgelöst werden müssen. Da die Linsen und Sensoren bauartbedingt einen gewissen Abstand zueinander haben müssen, können die Teilbilder nicht genau aus derselben Position aufgenommen werden. So kommt es zu einer leichten Verschiebung des Vorder- und Hintergrunds – ein Effekt, den man als „Daumensprung“ selbst ausprobieren kann, indem man den Daumen vor das Auge führt und abwechselnd nur mit dem rechten und nur mit dem linken Auge betrachtet. Die Überblendungsfehler werden beim Stitching (dem ‚Vernähen‘ der benachbarten Bilder zu einem 360°-Panorama) meist sichtbar. Professionelle Produktionsfirmen sind jedoch in der Lage, diese im Verlauf der anschließenden Postproduktion gänzlich zu entfernen bzw. zu retuschieren/kaschieren. Der erhöhte Produktionsaufwand lohnt sich allemal, denn eine VR-Erfahrung ohne sichtbare Parallaxeartefakte vereinfacht das Abtauchen des Nutzers in die immersive Bildwelt. Monoskopische 360°-Fotografien (angefertigt mit einem Nodalpunktadapter) und computergenerierte 3D-Umgebungen (Foto oder Video) sind in der Regel automatisch parallaxefrei.

Parallaxenfehler treten bei 360-Grad-Realfilmaufnahmen – gerade bei geringen Abständen – in den meisten Fällen auf. Sie können aber in der Postproduktion ausgebessert werden.

Interaktionsgrad

Abhängig vom gewählten Projektformat kann nun der Interaktionsgrad festgelegt werden. Wir unterscheiden hierbei zwischen vier Interaktionsleveln:

Das VR-Interaktionslevel 1 ermöglicht Nutzern ausschließlich, sich frei umzusehen. Weitere Interaktionsmöglichkeiten sind nicht möglich. Kompatible Formate sind 360°-Fotos und -Stills (real oder computergeneriert) sowie lineare 360-Grad-Filme. Dieses Interaktionslevel ist kompatibel mit einer Vielzahl an Social-Media-Kanälen sowie Web-, Mobile- und Desktop-Anwendungen.

Das VR-Interaktionslevel 2 erlaubt eine partielle Interaktion innerhalb der VR-Experience. Nutzer können beispielsweise grafische 2D-Hotspots aktivieren, um zwischen verschiedenen VR-Interaktionslevel-1-Erfahrungen zu navigieren. Für die Umsetzung dieser und aller folgenden Interaktionslevel ist jedoch eine individuelle App-Entwicklung erforderlich.

Für unseren Kunden Alfix haben wir eine interaktive Tour gestaltet, in der Nutzer mit grafischen Hotspots verschiedene Navigations- und Interaktionsmöglichkeiten auslösen können. Klicken Sie auf das Bild, um direkt zur Webversion der Tour zu gelangen.

Beim VR-Interaktionslevel 3 werden die Möglichkeiten der vorherigen Interaktionslevel durch Interaktionsmöglichkeiten angereichert, durch die der Nutzer Einfluss auf die filmische Handlung nehmen kann. Indem beispielsweise seine akustischen und optischen Feedbacks in Echtzeit registriert und ausgewertet werden, aktiviert der Nutzer bewusst oder unbewusst vorgefertigte Handlungsstränge innerhalb der VR-Experience – die Technologie, die wir zu diesem Zwecke entwickelt haben, nennen wir „Hyperresponsive Virtual Reality“. Diese Art der interaktiven Experience wird in Deutschland bislang nur von Aspekteins angeboten.

Neben klassischen 2D-Hotspots, wie sie auch im VR-Interaktionslevel 2 möglich sind, kann die Applikation beispielsweise auf folgende Interaktionen reagieren:

Reaktion auf Blickrichtung des Nutzers:

Schaut der Nutzer in eine bestimmte Richtung innerhalb der VR-Erfahrung, wird automatisch ein festgelegter Befehl ausgeführt (z.B. Video wird abgespielt, Musik fängt an zu spielen etc.).

Reaktion auf Lautstärke des Nutzers:

Überschreitet die Lautstärke des Nutzers (z.B. Stimme) während der VR-Erfahrung einen festgelegten Schwellenwert, wird automatisch ein festgelegter Befehl ausgeführt (z.B. Video wird abgespielt, Musik fängt an zu spielen etc.).

Reaktion auf das gesprochene Wort mithilfe von Spracherkennungssoftware:

Reagiert die implementierte Spracherkennungssoftware während der VR-Erfahrung auf ein gesprochenes Wort des Nutzers, wird automatisch ein festgelegter Befehl ausgeführt (z.B. Video wird abgespielt, Musik fängt an zu spielen etc.).

Weitere mögliche Trigger:

Uhrzeit, Aufmerksamkeit, Gaze Steering (klassische VR-Interaktion), Geräuschpegel über längeren Zeitraum, Bewegung, Standort, Wetter, Akkustand, externe Daten (z.B. statistische Auswertung der Entscheidungen anderer), WLAN, Mobilfunknetz, Empfangsstärke, Neuinstallation, abgelehnte Berechtigungen, vorherige Entscheidungen etc.

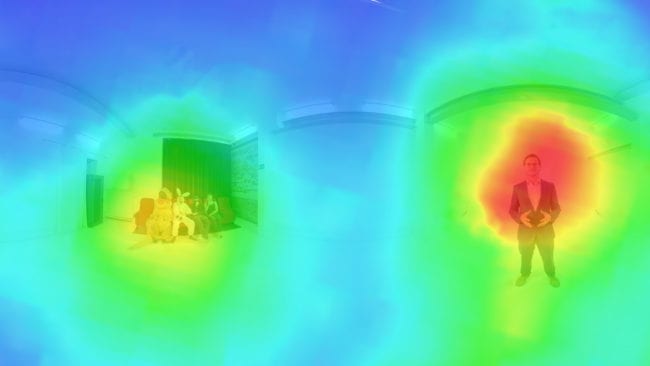

Die HRVR-Umgebung wertet das Verhalten des Nutzers aus, um ihm so unaufdringlich die für ihn passenden Inhalte anbieten zu können.

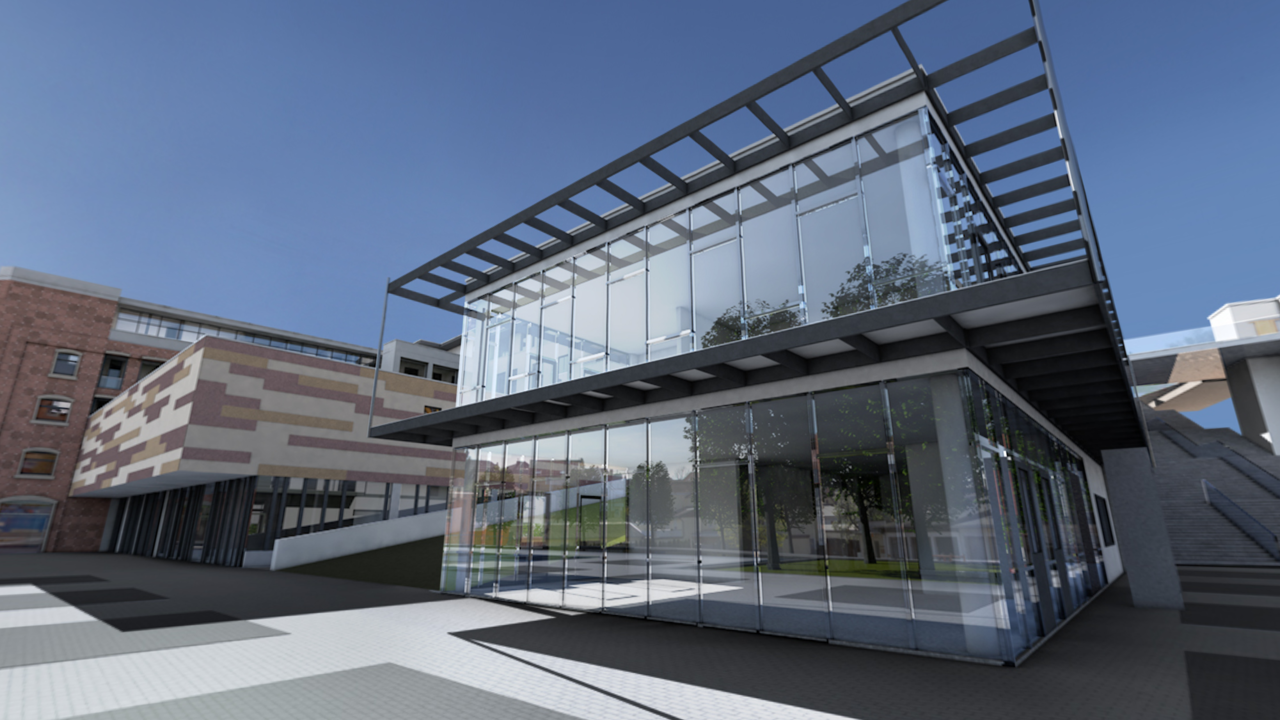

Das VR-Interaktionslevel 4 besteht letztlich komplett aus in Echtzeit berechneten Inhalten und zeichnet sich durch noch umfangreichere Interaktionsmöglichkeiten aus. Die Anwendung besteht in diesem Fall nicht mehr vorwiegend aus 360-Grad-Medien, sondern vielmehr aus 3D-Modellen und Animationen. Der Nutzer kann beispielsweise seine Position ändern, sich durch den virtuellen Raum bewegen und 3D-Objekte innerhalb der VR-Experience aktivieren, hochheben und drehen.

Auswertungsziele und Wiedergabehardware

Wir wissen jetzt im Groben, welche Art der Anwendung wir anpeilen. Als nächstes muss geklärt werden, wie Nutzer die Anwendung erleben sollen:

© Foto: NeONBRAND (Unsplash)

360-Grad-Medien des Interaktionslevels 1 können Online über Social-Media-Kanäle ausgespielt werden. Inhalte der Interaktionslevel 1 und 2 können auf der eigenen Webseite eingebunden werden. Applikationen der Interaktionslevel 1, 2 und 3 können in einer App für Smartphones bereitgestellt werden. Auf VR-Headsets können schlussendlich Anwendungen aller vier Interaktionslevel wiedergegeben werden. Doch nicht jedes VR-Headset eignet sich für jede Art der Applikation: Wir unterscheiden grob zwischen drei Arten von VR-Headsets:

– Autarke VR-Headsets mit drei Freiheitsgraden: Die einfachste Form eines VR-Headsets ermittelt lediglich die Kopfbewegung und – je nach Gerät – die Ausrichtung der Hand durch ein separates Eingabegerät. Diese Lösung eignet sich besonders für Anwendungen der Interaktionslevel 1-3 bei Auflösungen bis zu 4K. Im einfachsten Fall kann auch ein Smartphone in eine VR-Halterung (z.B. ein Google Cardboard) gesteckt werden, um dieses als Headset dieser Gattung zu verwenden.

– Autarke VR-Headsets mit sechs Freiheitsgraden: Diese Variante unterstützt die freie Bewegung im Raum und – mittels Eingabegeräte oder Handtracking – die freie Interaktion mit virtuellen Gegenständen, wird aber dennoch von einem mobilen Prozessor betrieben. Diese Variante eignet sich für einfache Anwendungen des Interaktionslevels 4. Da sie ohne Kabel auskommt, kann ein hoher Grad an Immersion erzielt werden. Die Brille mit dem deutlich größten Marktanteil in diesem Segment ist die Oculus Quest.

– Workstationbetriebene VR-Headsets mit sechs Freiheitsgraden: Für aufwendigere VR-Applikationen des Interaktionslevels 4 oder hoch aufgelösten Inhalten der Interaktionslevel 1-3 empfiehlt sich die Verwendung eines workstationbetriebenen VR-Headsets. In der Regel ist dieses durch ein Kabel mit einem leistungsfähigen Computer verbunden, der die Rechenarbeit übernimmt.

Neben diesen groben Kategorien gibt es weiterhin größere Unterschiede im Bereich der Eingabegeräte, Trackingsysteme, Auflösungen und Bildwiederholraten, die den Umfang dieses Artikels sprengen würden.

© Foto: Burst (Pexels)

Visuelle Qualität

Auf Basis dieser ersten Entscheidungen und in Anbetracht des zur Verfügung stehenden Budgets kann nun entschieden werden, welches Maß an visueller Qualität erzielt werden soll:

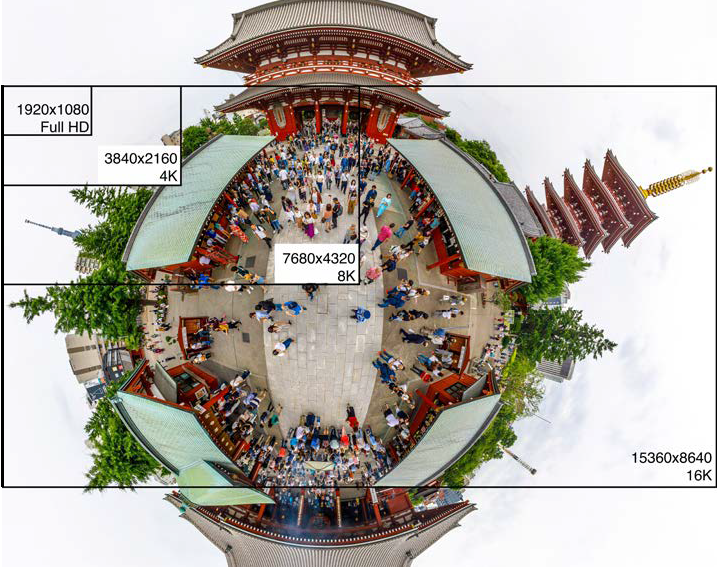

Bei 360-Grad-Medien (Interaktionslevel 1-3) ist hier der erste wichtige Faktor die Auflösung. Da bei der Wiedergabe des Films immer nur ein Ausschnitt des gesamten 360-Grad-Raumes gleichzeitig angezeigt wird, muss die Auflösung des kompletten Bilds entsprechend hoch sein. Wir empfehlen daher mindestens eine Auflösung von 4K (4096*2048px monoskopisch oder 4096*4096px stereoskopisch). Die meisten aktuell gebräuchlichen mobilen Prozessoren können keine höheren Auflösungen wiedergeben. Für die Darstellung an Headsets, die von einem externen Computer betrieben werden, sind auch höhere Auflösungen von 6K oder 8K sinnvoll. Für Spezialanwendungen kann die Auflösung sogar noch höher gesetzt werden. Höhere Auflösungen sind allerdings stets auch mit höherem Postproduktionsaufwand und großen Dateigrößen verbunden.

© Foto: Martijn Baudoin (Unsplash)

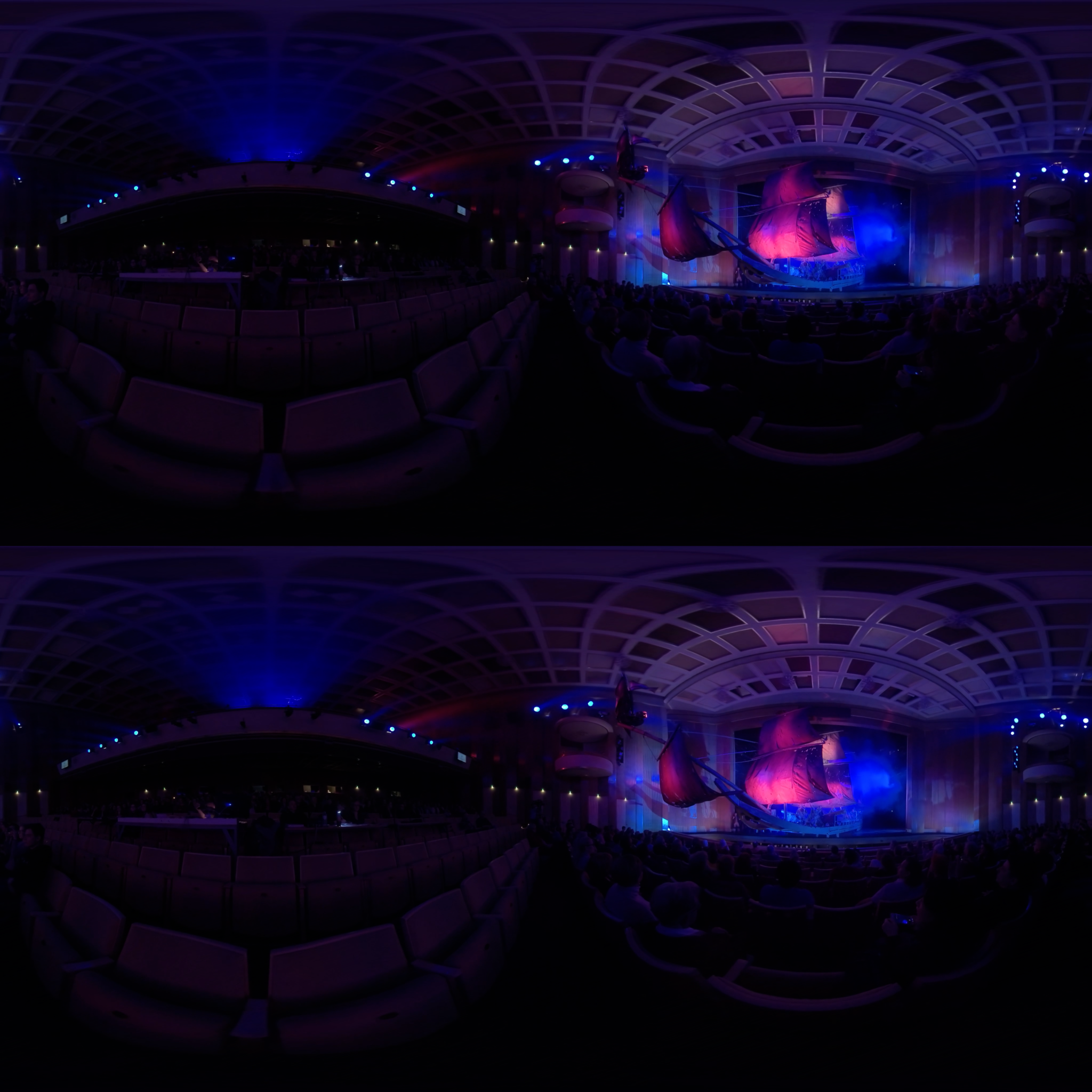

360-Grad-Medien können entweder monoskopisch oder stereoskopisch produziert werden. Stereoskopie kennt man aus dem Kino: Jedes Auge sieht ein leicht anderes Bild, wodurch ein Tiefeneindruck entsteht – genauso wie in 3D-Filmen. Da Nutzer im Falle von 360-Grad-Medien jedoch sowieso schon ein VR-Headset auf der Nase haben, wirkt dieser „3D-Effekt“ erfahrungsgemäß deutlich immersiver und überzeugender, als er das im Kino tut. Ist absehbar, dass die meisten Nutzer die finale Erfahrung mit einem VR-Headset ansehen werden, empfehlen wir daher, auf eine stereoskopische Umsetzung zu setzen. Wird der Film dagegen vor allem auf Smartphone und Desktop wiedergegeben, bringt die Stereoskopie keinen Mehrwert mit sich. Es gibt aber auch einige Einschränkungen und Nachteile von stereoskopischen Produktionen: Stereoskopische Filme sind in der Postproduktion bei auf Echtfilmmaterial basierten Filmen deutlich aufwendiger als monoskopische Filme, da für jede Szene zwei Bilder (eines für jedes Auge) bearbeitet und beide Bilder aufeinander abgeglichen werden müssen, um ein angenehmes und natürliches Seherlebnis zu ermöglichen. Bei computeranimierten Filmen fällt der Mehraufwand dagegen geringer aus. Im Nadir und Zenit (also direkt unter und direkt über der virtuellen Kamera) sind Inhalte des Weiteren auch in ansonsten stereoskopischen Szenen nur monoskopisch darstellbar, haben also keine Tiefe. Die Erklärung dafür liegt darin, dass stereoskopische 360-Grad-Medien nicht in Echtzeit berechnet werden, die Kopfrotation beim Auf- und Abschauen jedoch nicht schon im Vorfeld genau antizipiert werden kann. Um zu vermeiden, dass die Ausrichtung der Augen „verdreht“ dargestellt wird, müssen diese Bereiche „flach“ gehalten werden.

Bei stereoskopischen Videos wird je ein Bild für das linke Auge (oben) und das rechte Auge (unten) ausgegeben. In Kombination entsteht ein räumlicher Eindruck.

VR-Applikationen des Interaktionslevels 4 können stets stereoskopisch umgesetzt werden – da die Inhalte in Echtzeit berechnet werden, überwiegen hier in nahezu jedem Fall die Vorteile gegenüber einer monoskopischen Variante. Festgelegt werden muss allerdings, wie viele und welche Interaktionen Nutzern ermöglicht werden sollen: Welche Objekte kann der Nutzer in die Hand nehmen? Was reagiert auf eine Berührung des Nutzers? Wo sollen sich Nutzer hin bewegen können?

Bei computergenerierten Inhalten (aller Interaktionslevel) sollte in dieser Phase auch der Grad des Fotorealismus entschieden werden. Fotorealistische 3D-Modelle können sehr immersiv sein, sind in der Produktion jedoch – je nach dargestelltem Inhalt – sehr komplex. In vielen Fällen ist es daher zu empfehlen, auf eine stilisierte Gestaltung zu setzen. So kann, gerade bei menschlichen Charakteren, der „Uncanny-Valley-Effekt“ vermieden werden.

Auditive Immersionstiefe

Um das Immersiongefühl zu steigern und den Blick des Betrachters gezielt in der VR-Experience zu lenken, macht es mitunter Sinn, die VR-Erfahrung mit Spatial-Audio zu versehen. Dadurch bewegt sich der Ton in Abhängigkeit zur Blickrichtung des Nutzers in den Kopfhörern mit. Geräuschquellen wirken somit, als würden sie an einer festen Position im Raum stehen – ganz egal, in welche Richtung sich der Nutzer dreht. Dies entspricht unserem realen Höreindruck in der Welt stärker, als klassische fixierte Stereo- oder Dolby-Surround-Technologien, die nicht auf die Kopfbewegung reagieren.

© Foto: Pixabay (Pexels)

Für nonlineare, virtuelle Umgebungen (3D-computergeneriert) vom VR-Interaktionslevel 4 sollte man mit erweiterten Object-Based-Audio-Verfahren arbeiten. Zur Funktionsweise: Die im virtuellen Raum platzierten 3D-Modelle bekommen ein konkretes Geräusch zugewiesen (Vogel = Gezwitscher, Baum = Blätterrascheln). Bewegt sich der Nutzer und/oder das 3D-Modell nun durch den virtuellen Raum, verändert sich die Geräuschwiedergabe via Kopfhörer analog zur ausgeführten Bewegung. So kann der Nutzer ohne visuellen Anhaltspunkt und nur mit Hilfe des sich verändernden Audiosignals im Kopfhörer das dazugehörige 3D-Modell im virtuellen Raum orten. Object-Based-Audio ist vom Klangerlebnis mit Spatial Audio zu vergleichen. Allerdings ist es flexibler (da standortunabhängig) und genauer (da nicht auf Audiokanal-Limitierungen begrenzt, sondern in Echtzeit berechnet).

Feinkonzeption und Vorproduktion

© Foto: Alice Dietrich (Unsplash)

Auf Basis dieser ersten Informationen sammeln wir im Rahmen unseres Workshops zusammen mit Ihnen Ideen für Ihr individuelles Projekt. Nach Festlegung der Konzeptgrundlagen erstellen wir Ihnen Ihr individuelles Projektkonzept in Form eines PDF-Dokuments. Je nach Vereinbarung ist darin bereits vorläufiges Foto- und Grafikmaterial enthalten. Diese Previsualisierungen werden als Teil der Vorproduktion bereits detailliert ausgearbeitet und im Idealfall von Ihnen freigegeben. Somit können im Vorfeld bereits mögliche Designmissverständnisse geklärt und im Nachgang Feedback-Verzögerungen in der konkreten Projektumsetzung minimiert werden. Im Rahmen der Vorproduktion wird die Konzeptionsskizze feiner ausgearbeitet, bis hin zu bebilderten Detailbeschreibungen der Szenen. Diese werden dann im Dialog mit dem Auftraggeber angepasst, bis die Wunschvorstellung erreicht ist. Aufbauend auf der Detailbeschreibung werden Dispositionen, Szenenlisten und Drehbücher erstellt. Dann steht der Umsetzung Ihres Projekts nichts mehr im Wege.

Sie haben Interesse an einer Beratung von oder einem Workshop mit unserem Team? Wir helfen Ihnen gerne!

HIER KLICKEN FÜR IHRE PROJEKTANFRAGE

Bildrechte Titelbild: © Vale Zmeykov – Unsplash